在云原生時代,以容器和Kubernetes為核心的應用部署方式已成為主流。從Linux Foundation的Cloud Native Computing Foundation(CNCF)視角,尤其是大型開源峰會如LC3所聚焦的趨勢來看,Kubernetes環境下的可觀測性,特別是日志管理,是保障應用穩定運行、快速排障與深度洞察的關鍵支柱。本文將探討在Kubernetes架構下,如何系統性地實踐日志的采集、存儲與處理,并闡述相關的數據處理和存儲支持服務。

一、Kubernetes日志采集:從容器到集群

Kubernetes的日志采集面臨獨特挑戰:容器生命周期短暫、日志輸出分散(標準輸出/文件)、多副本實例等。主流實踐通常采用邊車模式或DaemonSet模式的日志代理。

- 采集模式與技術選型

- DaemonSet模式:在每個Kubernetes節點上部署一個日志采集代理(如Fluentd、Fluent Bit、Filebeat)。代理負責采集該節點上所有容器的標準輸出日志(通常位于

/var/log/containers/)以及可能的應用日志文件。這種方式資源占用相對集中,管理簡單,是CNCF生態中最常見的方式。Fluentd/Fluent Bit作為CNCF畢業項目,與Kubernetes集成度極高。

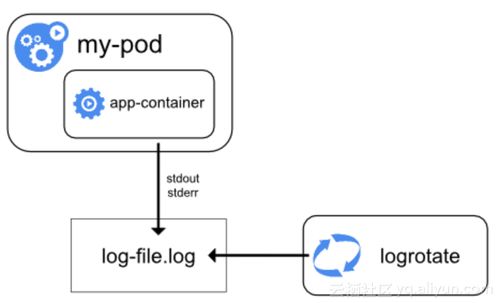

- 邊車模式:為每個需要特殊日志處理的應用Pod部署一個專用的日志采集邊車容器。這種方式更靈活,可以為特定應用定制采集邏輯,但會顯著增加資源開銷和部署復雜度。通常與DaemonSet模式結合使用。

- 應用直接寫入:鼓勵應用程序通過SDK或API直接將結構化日志發送到中央日志服務(如Loki的Push API,或遠程Syslog)。這減少了代理依賴,但對應用有侵入性。

- 最佳實踐

- 結構化日志:在應用層面輸出JSON等結構化日志,極大地方便后續的解析、過濾和索引。

- 使用元數據豐富日志:日志代理應自動為每條日志記錄附加豐富的元數據,如Pod名稱、命名空間、容器名稱、節點名稱、標簽等。這是Kubernetes環境下進行多維度日志查詢和關聯的基礎。

二、日志存儲:平衡性能、成本與查詢能力

海量日志的存儲需要平衡查詢性能、存儲成本和長期保留需求。

- 存儲架構

- 熱存儲/索引存儲:用于近期高頻查詢的日志。要求低延遲、高吞吐的查詢能力。常見選擇:

- Elasticsearch:功能全面,強大的全文搜索和聚合分析能力,生態成熟,但運維復雜,資源消耗大。

- Grafana Loki:CNCF孵化項目,設計理念是“為日志而生的Prometheus”。它只索引元數據(標簽),不對日志內容全文索引,將原始日志壓縮存儲于對象存儲(如S3、MinIO)。這種設計使得其資源效率極高,成本遠低于Elasticsearch,特別適合基于標簽的Kubernetes日志查詢模式。

- 冷存儲/歸檔存儲:用于滿足合規性或歷史分析需求的長期存儲。通常使用高性價比的對象存儲服務,如Amazon S3、Google Cloud Storage、Azure Blob Storage或開源的MinIO。Loki原生支持將數據存儲在對象存儲中,是其核心優勢之一。

- 數據處理和存儲支持服務

- 對象存儲服務:作為日志存儲的成本效益基石,提供幾乎無限的擴展性、高持久性和按需付費模式。不僅是歸檔層,也正逐漸成為Loki等系統的主存儲層。

- 托管搜索與分析服務:云廠商提供的Elasticsearch Service(如Amazon OpenSearch Service、Elastic Cloud)或托管Loki服務,可以大幅降低運維負擔。

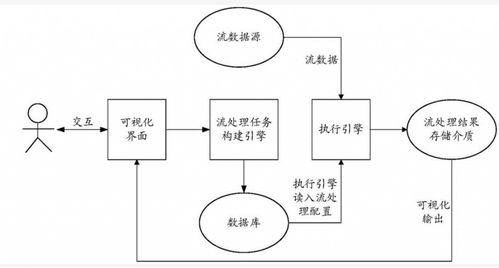

- 流處理與緩沖服務:在日志采集端與存儲端之間,引入緩沖層以應對流量峰值和防止數據丟失。例如使用Apache Kafka或CNCF項目NATS作為日志流的中轉與緩沖管道,實現解耦和背壓管理。

三、日志處理與分析:從檢索到洞察

存儲之后的處理與分析是釋放日志價值的關鍵。

- 處理流程

- 解析與轉換:在采集端或通過獨立的流處理管道(如使用Fluentd過濾器、Logstash或Vector),對非結構化日志進行解析(如Grok),提取關鍵字段,轉換為統一的數據模型。

- 過濾與路由:根據日志級別、關鍵字或標簽,將日志路由到不同的存儲目的地或處理管道。

- 聚合與指標生成:實時分析日志流,生成業務或應用性能指標(如錯誤率、特定事務數量),并輸入到監控系統(如Prometheus)進行告警。

- 查詢與可視化

- 統一查詢界面:Grafana已成為云原生領域事實上的可視化標準。它既可以連接Elasticsearch進行強大的全文檢索,也可以連接Loki進行高效的標簽查詢,實現對日志、指標、鏈路的統一觀測。

- 告警:基于日志模式(如大量錯誤日志出現)或計算出的指標,配置告警規則,實現主動問題發現。

四、實踐與趨勢展望

在LC3所代表的云原生社區視野下,Kubernetes日志管理的技術實踐正朝著更云原生、更高效、更集成的方向發展:

- 融合與簡化:Loki因其與Prometheus/Grafana棧的無縫集成和極低的資源開銷,正獲得越來越多的采納,挑戰著傳統的ELK/EFK棧。

- 無代理與OpenTelemetry:隨著OpenTelemetry項目的成熟,未來可能出現更統一的、無代理的遙測數據采集標準,將日志、指標、鏈路追蹤的采集融合。

- 智能分析:結合機器學習,對日志進行異常檢測、根因分析、趨勢預測,從被動響應轉向主動洞察。

- Serverless數據處理:利用云上的Serverless函數(如AWS Lambda)或流處理服務(如Google Cloud Dataflow),對日志進行按需的、事件驅動的處理,進一步降低運維復雜性。

構建Kubernetes下的日志體系,需要根據團隊規模、技術棧、成本預算和對可觀測性的需求,合理選擇從采集、緩沖、存儲到分析的工具鏈與服務。以CNCF生態為核心,采用如Fluent Bit + Loki + Grafana這樣的輕量級組合,或結合云廠商的托管服務,能夠高效地構建起一個強大、經濟且面向未來的云原生日志平臺。